|

👇🏻 Dê o play para ouvir o conteúdo! 🔊

Getting your Trinity Audio player ready...

|

Atualizado em 18 de março de 2026

NOTA DA AUTORA: Este artigo integra o projeto de Inteligência de Conteúdo, que estuda como a organização da informação melhora respostas de IA e influencia decisões humanas.

Como pensar sobre as reflexões éticas na IA em 2026?

Hoje, algoritmos já influenciam o que vemos online, como empresas selecionam currículos e até como alguns diagnósticos são priorizados.

Neste artigo, você vai entender por que surgem dilemas éticos na inteligência artificial, quais riscos realmente existem e como analisar essas situações com mais clareza.

Para começar, vale construir um modelo mental simples sobre como decisões automatizadas afetam pessoas no mundo real.

Para entender rapidamente:

- A ética na inteligência artificial surge porque algoritmos já influenciam decisões humanas, como seleção de currículos, recomendações de conteúdo e análises financeiras.

- Sistemas de IA aprendem com dados do mundo real, que podem conter desigualdades e padrões históricos, o que pode gerar viés algorítmico.

- A tecnologia consegue reconhecer padrões, mas não entende contexto social, justiça ou consequências morais.

- Por isso, decisões importantes que envolvem IA exigem transparência, responsabilidade e supervisão humana.

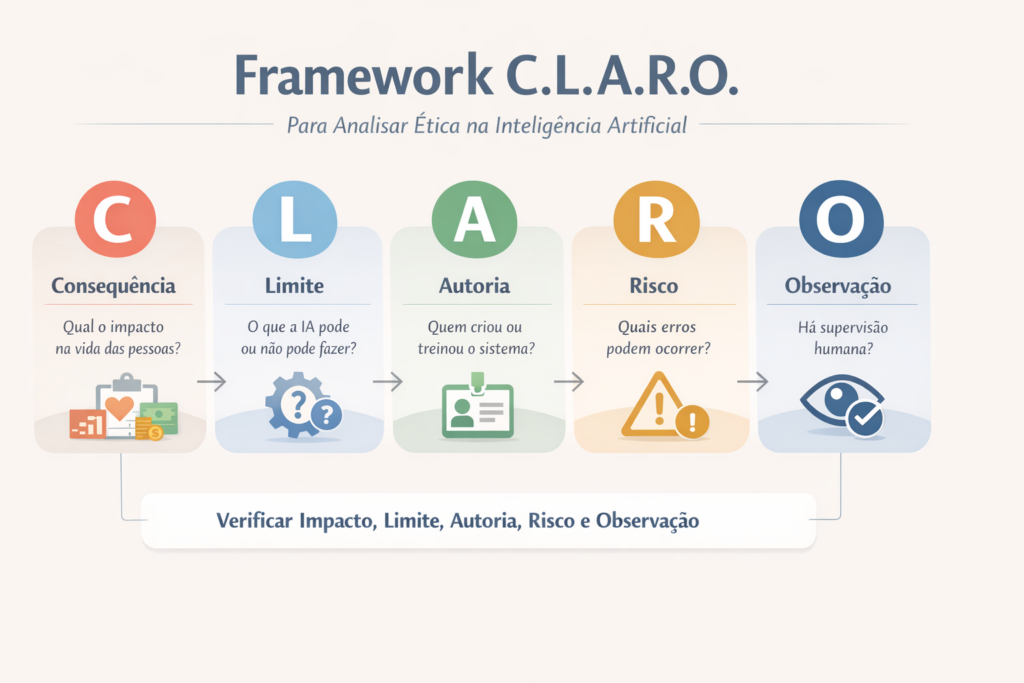

- Este artigo apresenta os principais dilemas éticos da IA e um modelo simples para avaliá-los: o Framework C.L.A.R.O..

Por que as reflexões éticas na inteligência artificial se tornaram inevitáveis?

Reflexões éticas na IA se tornaram inevitáveis porque sistemas algorítmicos já influenciam decisões que afetam pessoas, organizações e instituições.

Quanto maior o alcance da tecnologia, maior a necessidade de avaliar seus impactos, limites e responsabilidades.

A ética em IA surge quando a tecnologia deixa de ser apenas uma ferramenta técnica e passa a interferir diretamente em decisões humanas.

Nesse ponto, eficiência computacional não é suficiente: torna-se necessário considerar consequências sociais, transparência e supervisão.

Nos últimos anos, a inteligência artificial deixou de operar apenas em laboratórios ou aplicações especializadas.

Hoje, algoritmos participam de sistemas que organizam informações, priorizam conteúdos, sugerem decisões e influenciam escolhas em larga escala.

Essa mudança de escala é o que torna o debate ético inevitável.

Quando algoritmos começam a influenciar decisões que afetam pessoas, tecnologia e ética passam a fazer parte da mesma discussão.

Esse cenário não significa que a inteligência artificial seja intrinsecamente problemática.

O ponto central é que tecnologias que influenciam decisões precisam de critérios claros de uso.

Para compreender por que essa discussão ganhou força, é útil observar três mudanças recentes na forma como a IA passou a operar no cotidiano.

O crescimento acelerado da inteligência artificial no cotidiano

A inteligência artificial se expandiu rapidamente porque se tornou capaz de analisar grandes volumes de dados e gerar recomendações úteis em tempo real.

Isso permitiu que sistemas de IA fossem incorporados a ferramentas usadas diariamente por empresas e usuários.

Hoje, algoritmos ajudam a organizar informações em diversos contextos:

- plataformas digitais que recomendam conteúdos

- ferramentas que analisam dados de negócios

- sistemas que auxiliam diagnósticos médicos

- softwares que priorizam tarefas ou classificam documentos

Essa presença crescente transforma a IA em infraestrutura invisível da decisão digital.

Segundo o AI Index Report do Stanford Human-Centered AI Institute, cerca de 78% das organizações já utilizam inteligência artificial em pelo menos uma função de negócios, indicando que decisões assistidas por algoritmos passaram a integrar o funcionamento cotidiano de muitas atividades empresariais.

Exemplo simples:

Uma plataforma digital utiliza IA para recomendar conteúdos com base no comportamento do usuário.

O objetivo técnico é melhorar relevância e engajamento.

Mas essa escolha também define quais informações as pessoas veem primeiro — o que mostra como decisões algorítmicas começam a influenciar ambientes informacionais.

Quando decisões automatizadas começam a afetar pessoas?

A reflexão ética ganha importância quando sistemas automatizados deixam de apenas organizar dados e passam a influenciar oportunidades, recursos ou acesso à informação.

Isso ocorre porque decisões baseadas em algoritmos podem impactar diretamente a vida das pessoas.

Comparação simples

| Uso técnico da IA | Impacto humano potencial |

|---|---|

| Analisar grandes volumes de dados | Pode influenciar quais decisões são consideradas |

| Automatizar classificações | Pode priorizar ou excluir determinadas opções |

| Recomendar informações | Pode moldar o ambiente de escolha das pessoas |

Quando algoritmos ajudam a filtrar currículos, organizar feeds ou sugerir diagnósticos, eles passam a participar do processo decisório.

Mesmo que a decisão final ainda seja humana, o ambiente de decisão já foi influenciado pela tecnologia.

Por que eficiência tecnológica não resolve dilemas humanos?

Sistemas de inteligência artificial são projetados para identificar padrões em dados.

Esse tipo de análise pode ser extremamente eficiente para prever comportamentos ou encontrar correlações.

O problema é que decisões humanas não dependem apenas de padrões estatísticos.

Elas também envolvem fatores como:

- justiça

- contexto social

- valores culturais

- responsabilidade por consequências

Algoritmos conseguem reconhecer regularidades nos dados, mas não compreendem significado moral ou impacto social.

Inteligência artificial pode melhorar eficiência de decisões, mas não substitui julgamento humano em situações que envolvem valores ou consequências sociais.

Esse limite estrutural explica por que a discussão sobre ética em IA não é apenas filosófica.

Ela surge sempre que tecnologias passam a influenciar decisões relevantes em larga escala.

É exatamente nesse ponto que surgem os principais dilemas analisados ao longo deste artigo, como viés algorítmico, privacidade de dados, responsabilidade por erros e transparência de sistemas automatizados — temas que serão explorados nesta série.

O que realmente significa ética na inteligência artificial?

Ética na inteligência artificial é o conjunto de princípios que orienta como sistemas algorítmicos devem ser desenvolvidos e usados de forma responsável.

O objetivo é garantir que decisões automatizadas respeitem direitos, reduzam riscos e mantenham supervisão humana quando necessário.

A discussão ética surge quando tecnologias deixam de apenas processar dados e passam a influenciar decisões que afetam pessoas.

Nesse ponto, eficiência técnica não é suficiente: é preciso considerar impacto social, responsabilidade e transparência.

A inteligência artificial funciona identificando padrões em grandes volumes de dados.

Esse processo permite automatizar análises e recomendações, mas também levanta questões importantes sobre como essas decisões são produzidas e quais consequências podem gerar.

Por isso, a ética em IA busca responder perguntas como:

- Quem é responsável por decisões assistidas por algoritmos?

- Como evitar que sistemas reproduzam desigualdades presentes nos dados?

- Quando a supervisão humana precisa estar presente?

Quando sistemas automatizados começam a influenciar decisões humanas, a tecnologia passa a exigir critérios éticos claros de uso.

Esse campo de discussão não se limita a uma única área.

Ele conecta temas como viés algorítmico, privacidade de dados, transparência tecnológica e responsabilidade por erros — tópicos explorados ao longo deste silo.

Diferença entre ética tecnológica e ética aplicada

A ética relacionada à tecnologia pode ser analisada em dois níveis: princípios gerais sobre inovação e decisões práticas sobre como sistemas são usados no mundo real.

| Perspectiva | Foco principal |

|---|---|

| Ética tecnológica | Debate princípios gerais sobre o impacto de novas tecnologias |

| Ética aplicada à IA | Analisa situações concretas em que algoritmos influenciam decisões |

A distinção é importante porque muitos dilemas surgem não apenas da tecnologia em si, mas da forma como ela é implementada em ambientes reais.

Por exemplo, um algoritmo de recomendação pode funcionar corretamente do ponto de vista técnico, mas ainda gerar efeitos sociais inesperados dependendo do contexto de uso.

Por que algoritmos não possuem julgamento moral?

Algoritmos não possuem julgamento moral porque operam com modelos matemáticos treinados em dados, e não com compreensão de valores humanos.

Eles conseguem:

- identificar padrões estatísticos

- classificar informações

- gerar previsões com base em dados históricos

Mas não conseguem interpretar conceitos como justiça, intenção ou responsabilidade.

Sistemas de inteligência artificial analisam padrões em dados, mas não compreendem valores humanos ou consequências morais.

Essa limitação estrutural explica por que decisões que envolvem impacto social precisam ser analisadas com cuidado quando algoritmos fazem parte do processo.

Qual o papel da supervisão humana em sistemas automatizados?

A supervisão humana é necessária porque sistemas de IA podem gerar resultados tecnicamente corretos, mas socialmente problemáticos.

Por isso, muitas aplicações seguem um modelo conhecido como decisão assistida por IA, no qual a tecnologia organiza informações, mas a decisão final permanece sob responsabilidade humana.

Exemplo comum:

Um sistema automatizado pode filtrar currículos com base em critérios definidos previamente.

No entanto, recrutadores humanos revisam essas recomendações antes de tomar a decisão final.

Esse tipo de abordagem busca equilibrar duas forças:

- eficiência computacional da IA

- julgamento contextual humano

Quanto maior o impacto de uma decisão automatizada, maior deve ser o nível de supervisão humana no processo.

Esse princípio ajuda a entender por que a ética em inteligência artificial não se resume a tecnologia, mas envolve também governança, responsabilidade e critérios de uso, temas aprofundados nos próximos artigos desta série.

Quais os principais dilemas éticos da inteligência artificial hoje?

Os dilemas éticos da inteligência artificial surgem quando sistemas algorítmicos começam a influenciar decisões que afetam pessoas, direitos e recursos.

Esses desafios aparecem porque a capacidade técnica da IA cresce mais rápido do que os mecanismos sociais de controle e responsabilidade.

À medida que a inteligência artificial passa a organizar informações, recomendar decisões e automatizar processos, surgem perguntas fundamentais sobre impacto, limites e governança.

Esses dilemas não são um único problema isolado.

Eles formam um conjunto de questões interligadas que envolvem tecnologia, sociedade, economia e instituições.

Por isso, compreender a ética em IA exige observar diferentes áreas onde decisões automatizadas podem gerar consequências reais.

Os dilemas éticos da inteligência artificial surgem quando sistemas técnicos passam a influenciar decisões humanas em larga escala.

Diversos centros de pesquisa, como o Stanford Human-Centered AI Institute e a OECD, destacam que a expansão da inteligência artificial levanta questões recorrentes sobre transparência, viés algorítmico e responsabilidade, especialmente quando sistemas automatizados passam a influenciar decisões que afetam pessoas, acesso à informação ou distribuição de recursos.

A seguir estão alguns dos principais dilemas discutidos atualmente. Cada um deles é aprofundado em artigos específicos desta série.

Viés algorítmico e reprodução de desigualdades

O viés algorítmico ocorre quando sistemas de inteligência artificial reproduzem padrões presentes nos dados usados para treiná-los.

Se os dados refletem desigualdades históricas, o algoritmo pode acabar replicando essas distorções.

Isso significa que decisões automatizadas podem, sem intenção explícita, reforçar desigualdades existentes.

Exemplo simples:

Um sistema usado para triagem de currículos pode aprender padrões históricos de contratação.

Se determinados grupos foram menos contratados no passado, o algoritmo pode acabar reproduzindo esse padrão.

Esse tema é aprofundado no cluster sobre viés algorítmico e justiça em IA.

Privacidade e coleta massiva de dados

Grande parte dos sistemas de inteligência artificial depende de grandes volumes de dados para funcionar com precisão.

Isso cria tensões entre inovação tecnológica e proteção de informações pessoais.

Quanto mais dados são coletados e analisados, maior é a necessidade de discutir:

- consentimento

- limites de uso

- proteção de dados sensíveis

Exemplo comum:

Plataformas digitais utilizam dados de comportamento para melhorar recomendações.

Ao mesmo tempo, isso levanta questões sobre quanto dessas informações deve ser coletado ou armazenado.

Esse tema conecta-se ao cluster sobre privacidade e uso de dados em inteligência artificial.

Direitos autorais e conteúdo criado por IA

Sistemas generativos conseguem produzir textos, imagens, músicas e vídeos com base em padrões aprendidos em grandes conjuntos de dados.

Esse avanço levanta dúvidas sobre autoria, uso de obras existentes e remuneração de criadores humanos.

Perguntas comuns incluem:

- Quem é o autor de um conteúdo criado por IA?

- Obras usadas no treinamento precisam de autorização?

- Como proteger o trabalho criativo em ambientes automatizados?

Essas questões são exploradas no cluster sobre direitos autorais e IA generativa.

Automação e impacto no mercado de trabalho

A automação sempre fez parte da evolução tecnológica. A diferença atual é a velocidade com que a inteligência artificial consegue assumir tarefas cognitivas, além das atividades mecânicas.

Isso gera debates sobre:

- transformação de profissões

- criação de novas funções

- necessidade de requalificação profissional

Exemplo simples:

Ferramentas de IA podem automatizar análise de dados ou produção de textos básicos, alterando a forma como determinadas atividades são realizadas no trabalho.

Esse cenário é discutido no cluster sobre IA e transformação do mercado de trabalho.

Confiabilidade de decisões algorítmicas

Sistemas de inteligência artificial são frequentemente utilizados para gerar previsões ou recomendações.

No entanto, esses resultados dependem da qualidade dos dados e do modelo utilizado.

Por isso, uma questão central é até que ponto decisões baseadas em IA devem ser consideradas confiáveis.

| Situação | Risco ético |

|---|---|

| Dados incompletos | decisões imprecisas |

| Dados enviesados | conclusões distorcidas |

| Falta de revisão humana | erros passam despercebidos |

Esse dilema é aprofundado no cluster sobre confiabilidade e avaliação de sistemas de IA.

O problema da “caixa-preta” dos algoritmos

Muitos sistemas de inteligência artificial funcionam com modelos complexos que tornam difícil compreender exatamente como uma decisão foi produzida.

Esse fenômeno é conhecido como “caixa-preta algorítmica”.

Quando não é possível entender claramente o processo de decisão, surgem desafios como:

- dificuldade de auditoria

- falta de transparência

- limitações para explicar resultados

Esse tema é explorado no cluster sobre transparência e explicabilidade em IA.

Responsabilidade quando a inteligência artificial erra

Sistemas automatizados podem cometer erros, especialmente quando operam em ambientes complexos ou com dados imperfeitos.

Quando isso acontece, surge uma pergunta central:

Quem é responsável pela decisão?

Possíveis envolvidos incluem:

- desenvolvedores do sistema

- empresas que utilizam a tecnologia

- instituições que regulam seu uso

Esse dilema aparece em debates sobre responsabilidade e governança em inteligência artificial.

IA em áreas sensíveis como medicina e saúde

Em setores como saúde, decisões automatizadas podem ter impacto direto no bem-estar das pessoas.

A inteligência artificial pode auxiliar diagnósticos, organizar dados médicos ou identificar padrões clínicos.

Porém, seu uso exige critérios rigorosos de validação e supervisão.

Exemplo:

Um sistema de IA pode identificar padrões em exames médicos.

Ainda assim, o diagnóstico final permanece sob responsabilidade de profissionais de saúde.

Esse tema é aprofundado no cluster sobre uso responsável de IA na medicina.

Deepfakes e manipulação da realidade digital

Tecnologias de geração de imagem e vídeo conseguem criar conteúdos extremamente realistas que simulam pessoas dizendo ou fazendo coisas que nunca ocorreram.

Esses conteúdos são conhecidos como deepfakes.

O problema ético surge quando essas ferramentas são usadas para:

- desinformação

- manipulação política

- fraudes digitais

Esse fenômeno será explorado no cluster sobre deepfakes e integridade da informação.

Uso de inteligência artificial na educação

Ferramentas de IA já fazem parte de ambientes educacionais, auxiliando produção de conteúdo, revisão de textos e organização de estudos.

Ao mesmo tempo, surgem debates sobre:

- limites do uso por estudantes

- impacto na aprendizagem

- adaptação de métodos de ensino

Essas questões são analisadas no cluster sobre IA aplicada à educação.

Impacto ambiental e custo energético da IA

Treinar e operar grandes modelos de inteligência artificial exige infraestrutura computacional significativa.

Isso envolve:

- centros de dados

- alto consumo de energia

- demanda crescente por capacidade computacional

Por isso, cresce o debate sobre sustentabilidade tecnológica e eficiência energética no desenvolvimento de IA.

Esse tópico é explorado no cluster sobre impacto ambiental da inteligência artificial.

Governança global e necessidade de regulação

À medida que a inteligência artificial se torna parte da infraestrutura digital global, cresce a discussão sobre regras, padrões e responsabilidade institucional.

Diversos países e organizações internacionais estão debatendo:

- princípios de uso responsável

- normas de transparência

- mecanismos de supervisão

Instituições como a OECD, a UNESCO e a União Europeia já publicaram diretrizes para orientar políticas públicas sobre IA.

Esse tema conecta-se ao guia sobre regulação e governança da inteligência artificial.

Os dilemas éticos da inteligência artificial não surgem da tecnologia isoladamente, mas das decisões humanas sobre como sistemas algorítmicos são desenvolvidos, usados e regulados.

Nos próximos artigos desta série, cada um desses temas será analisado em profundidade para compreender como a sociedade pode equilibrar inovação tecnológica e responsabilidade social.

Como decisões da IA já influenciam o mundo real?

Decisões da inteligência artificial já influenciam o mundo real porque algoritmos passaram a participar da análise de dados, da priorização de informações e da recomendação de ações.

Mesmo quando a decisão final é humana, o sistema pode moldar quais opções aparecem primeiro ou parecem mais relevantes.

Hoje, muitos sistemas de IA funcionam como infraestrutura de decisão.

Eles organizam grandes volumes de dados e geram sugestões que orientam escolhas em empresas, plataformas digitais e serviços públicos.

Isso significa que a tecnologia não está apenas automatizando tarefas. Em muitos contextos, ela já participa do processo que antecede decisões humanas.

Compreender essa influência é essencial para discutir ética em inteligência artificial, porque impactos sociais surgem quando algoritmos passam a interferir em escolhas reais.

A influência da IA não depende apenas de decisões totalmente automatizadas; ela também ocorre quando algoritmos moldam o ambiente de decisão humano.

Para entender melhor esse cenário, é útil observar onde esses sistemas já atuam e como eles participam das decisões.

Onde algoritmos já participam de decisões humanas?

Algoritmos estão presentes em diversas ferramentas digitais usadas diariamente.

Em muitos casos, eles ajudam a filtrar informações, identificar padrões ou sugerir prioridades.

Alguns exemplos comuns incluem:

- plataformas que recomendam conteúdos ou produtos

- sistemas que analisam dados financeiros ou operacionais

- softwares que auxiliam triagem de currículos

- ferramentas que identificam padrões em exames médicos

- sistemas que priorizam chamados ou atendimentos

Esses sistemas não tomam necessariamente a decisão final.

Porém, eles influenciam como as informações são organizadas e apresentadas, o que pode afetar escolhas posteriores.

Exemplo simples:

Um algoritmo de recomendação pode definir quais conteúdos aparecem primeiro em uma plataforma digital.

Essa organização altera o ambiente informacional em que o usuário toma decisões.

Esse tipo de influência explica por que decisões mediadas por IA se tornaram um tema central nas discussões sobre tecnologia e sociedade.

Diferença entre decisão automatizada e decisão assistida

Nem toda decisão envolvendo inteligência artificial é totalmente automática.

Em muitos casos, a tecnologia atua como suporte ao julgamento humano.

| Tipo de decisão | Característica principal |

|---|---|

| Decisão automatizada | o sistema executa a ação sem intervenção humana direta |

| Decisão assistida | a IA analisa dados e sugere opções, mas a decisão final é humana |

Essa distinção é importante porque o impacto ético muda dependendo do grau de autonomia do sistema.

Em decisões assistidas, a inteligência artificial funciona como uma ferramenta de apoio.

Já em decisões totalmente automatizadas, o sistema passa a executar ações diretamente com base nos dados analisados.

Essa diferença será aprofundada no artigo sobre confiabilidade e supervisão de sistemas de IA.

Quando a influência algorítmica se torna um risco ético?

A influência da inteligência artificial se torna um risco ético quando decisões algorítmicas começam a afetar direitos, oportunidades ou acesso a recursos.

Isso pode acontecer em situações como:

- triagem automatizada em processos de contratação

- sistemas de recomendação que moldam acesso à informação

- algoritmos que classificam prioridades em serviços públicos

- ferramentas que auxiliam decisões médicas ou financeiras

A influência algorítmica se torna um problema ético quando decisões baseadas em dados passam a afetar pessoas sem transparência, supervisão ou critérios claros de responsabilidade.

Exemplo contextual:

Um sistema pode priorizar determinados currículos com base em padrões estatísticos.

Se os dados usados no treinamento contiverem distorções históricas, o algoritmo pode reproduzir essas tendências sem intenção explícita.

Esse tipo de situação mostra por que o debate sobre ética em IA não se limita à tecnologia em si, mas envolve como sistemas automatizados são projetados, supervisionados e utilizados.

Nos próximos artigos desta série, cada um desses aspectos será analisado com mais profundidade, explorando os principais dilemas éticos associados ao uso crescente da inteligência artificial.

Qual o limite estrutural da inteligência artificial?

O limite estrutural da inteligência artificial está no fato de que algoritmos conseguem identificar padrões em dados, mas não compreendem significado, contexto social ou consequências humanas.

Por isso, sistemas de IA podem gerar respostas eficientes sem necessariamente produzir decisões justas ou adequadas.

A inteligência artificial funciona analisando grandes volumes de dados para encontrar regularidades estatísticas.

Esse processo permite gerar previsões, classificações e recomendações com alta eficiência.

No entanto, esse tipo de análise não envolve compreensão real da situação.

O sistema não entende valores humanos, intenções ou impacto social — ele apenas calcula probabilidades com base em dados disponíveis.

Esse limite explica por que decisões que envolvem pessoas, direitos ou responsabilidades exigem interpretação humana além da análise algorítmica.

Inteligência artificial é poderosa para reconhecer padrões em dados, mas não possui compreensão contextual nem julgamento moral.

Compreender essa limitação ajuda a explicar muitos dos dilemas éticos discutidos neste silo.

IA reconhece padrões, mas não entende contexto

Sistemas de inteligência artificial são treinados para identificar relações estatísticas em grandes conjuntos de dados.

Isso permite reconhecer padrões complexos que seriam difíceis de detectar manualmente.

Porém, identificar padrões não significa compreender o contexto em que esses dados foram gerados.

| Capacidade da IA | Limitação estrutural |

|---|---|

| Identificar correlações em dados | Não entende significado social |

| Reconhecer padrões recorrentes | Não interpreta intenções humanas |

| Gerar previsões estatísticas | Não avalia consequências éticas |

Essa diferença é fundamental: analisar dados não é o mesmo que compreender situações humanas.

Exemplo simples:

Um sistema pode detectar que determinado perfil aparece com menor frequência em contratações passadas.

Sem interpretação humana, o algoritmo pode tratar esse padrão apenas como um dado estatístico, sem questionar suas causas sociais.

Por que dados históricos podem distorcer decisões?

Grande parte dos sistemas de IA aprende com dados históricos. Isso significa que decisões passadas influenciam diretamente o comportamento futuro do algoritmo.

O problema é que dados históricos podem refletir contextos sociais imperfeitos, incluindo desigualdades ou distorções.

Quando esses dados são usados para treinar sistemas automatizados, o modelo pode reproduzir padrões antigos sem considerar se eles deveriam ser mantidos.

Quando algoritmos aprendem com dados históricos, eles podem reproduzir padrões do passado mesmo quando esses padrões não são desejáveis no presente.

Exemplo contextual:

Se um conjunto de dados contém registros de contratações que favoreceram determinados perfis ao longo do tempo, um sistema treinado com esses dados pode reproduzir essa tendência ao priorizar candidatos semelhantes.

Esse tipo de situação explica por que o debate sobre viés algorítmico e qualidade dos dados se tornou central nas discussões sobre ética em IA.

O problema da confiança excessiva em algoritmos

Outro limite importante surge quando usuários passam a confiar excessivamente em sistemas automatizados.

Resultados gerados por inteligência artificial muitas vezes parecem objetivos ou neutros porque são baseados em cálculos matemáticos.

No entanto, esses resultados dependem de fatores como:

- qualidade dos dados utilizados

- critérios definidos no treinamento

- limites do modelo utilizado

Decisões algorítmicas podem parecer neutras, mas sempre refletem escolhas humanas feitas durante o desenvolvimento do sistema.

Exemplo prático:

Uma ferramenta de análise pode recomendar determinada estratégia com base em dados anteriores.

Se o contexto atual mudou, seguir a recomendação sem análise humana pode gerar decisões inadequadas.

Por isso, muitos especialistas defendem que sistemas de inteligência artificial devem funcionar como apoio à decisão, e não como substitutos do julgamento humano.

Esse princípio ajuda a compreender por que ética em inteligência artificial envolve não apenas tecnologia, mas também supervisão, responsabilidade e critérios claros de uso — temas aprofundados nos clusters deste silo.

O Modelo C.L.A.R.O.: um método simples para avaliar ética em IA

O Modelo C.L.A.R.O. é um método simples para analisar decisões envolvendo inteligência artificial de forma ética e responsável.

Ele organiza cinco perguntas essenciais que ajudam a avaliar impacto, limites e responsabilidade no uso de sistemas automatizados.

Esse modelo funciona como um mapa mental prático para refletir sobre o uso da IA no mundo real.

Em vez de discutir ética apenas em termos abstratos, o método transforma o tema em critérios observáveis que podem ser aplicados em diferentes situações.

A proposta do modelo é ajudar qualquer pessoa — inclusive iniciantes — a observar decisões mediadas por inteligência artificial com mais clareza.

O Modelo C.L.A.R.O. transforma a ética em inteligência artificial em cinco perguntas práticas que ajudam a avaliar impacto, limites e responsabilidade no uso da tecnologia.

As cinco dimensões do modelo funcionam como um roteiro de análise:

| Elemento | Pergunta central |

|---|---|

| Consequência | Que impacto essa decisão pode gerar? |

| Limite | O que o sistema realmente consegue compreender? |

| Autoria | Quem responde pelo uso da tecnologia? |

| Risco | Quais erros ou distorções podem ocorrer? |

| Observação humana | Quando a supervisão humana é necessária? |

Esse tipo de estrutura ajuda a organizar debates sobre ética em IA de forma acessível, conectando tecnologia, responsabilidade e impacto social.

Exemplo simples de aplicação:

Imagine uma empresa usando IA para classificar currículos.

Aplicando o modelo C.L.A.R.O., seria possível perguntar:

- a decisão pode afetar oportunidades de trabalho?

- o sistema entende contexto profissional ou apenas padrões históricos?

- quem responde por decisões injustas?

- quais erros o algoritmo pode cometer?

- quando um recrutador deve revisar o resultado?

Esse tipo de reflexão mostra como decisões aparentemente técnicas podem envolver questões éticas relevantes.

Consequência: qual impacto essa decisão pode gerar?

A dimensão Consequência analisa quais efeitos uma decisão baseada em inteligência artificial pode gerar para pessoas ou organizações.

Nem toda decisão automatizada possui o mesmo peso.

Algumas apenas organizam informações, enquanto outras podem influenciar oportunidades ou acesso a recursos.

Avaliar ética em IA começa identificando quais consequências uma decisão automatizada pode produzir no mundo real.

Quanto maior o impacto potencial da decisão, maior deve ser o nível de atenção ética e supervisão.

Limite: o que o sistema realmente consegue fazer?

A dimensão Limite observa até onde a tecnologia realmente consegue operar de forma confiável.

Sistemas de IA funcionam reconhecendo padrões em dados, mas não compreendem significado social ou contexto humano.

Por isso, avaliar ética em IA também envolve perguntar:

- o sistema entende o problema ou apenas analisa padrões estatísticos?

- existem aspectos humanos que o algoritmo não consegue interpretar?

Compreender esses limites evita expectativas irreais sobre o que a tecnologia pode resolver.

Autoria: quem é responsável pela tecnologia?

A dimensão Autoria analisa quem responde pelas decisões associadas ao uso da inteligência artificial.

Mesmo quando algoritmos participam do processo de decisão, a responsabilidade continua sendo humana.

Desenvolvedores, empresas e instituições possuem papéis diferentes nesse processo.

Sistemas de IA não possuem responsabilidade moral; a responsabilidade sempre pertence às pessoas e organizações que os desenvolvem ou utilizam.

Esse ponto é central para debates sobre governança e uso responsável da tecnologia.

Risco: quais erros podem acontecer?

A dimensão Risco considera quais tipos de erro podem surgir quando sistemas automatizados são utilizados.

Algoritmos podem falhar por diferentes motivos:

- dados incompletos

- padrões históricos distorcidos

- contextos novos que o modelo não reconhece

Analisar riscos ajuda a entender onde decisões automatizadas precisam de maior cautela.

Observação humana: quando a supervisão é indispensável?

A dimensão Observação humana analisa quando decisões baseadas em IA precisam de acompanhamento humano.

Em muitas situações, a inteligência artificial funciona melhor como apoio à decisão, e não como substituta do julgamento humano.

Isso ocorre principalmente quando decisões envolvem:

- impacto social relevante

- avaliação contextual

- responsabilidade institucional

Quanto maior o impacto humano de uma decisão automatizada, maior deve ser o nível de supervisão humana no processo.

Esse princípio ajuda a equilibrar dois elementos importantes: a eficiência da tecnologia e a responsabilidade humana.

Ao longo dos próximos artigos desta série, o Modelo C.L.A.R.O. será utilizado como referência para analisar diferentes dilemas éticos da inteligência artificial, permitindo observar cada tema de forma estruturada e comparável.

Como aplicar análise ética ao usar inteligência artificial no dia a dia?

Aplicar análise ética ao usar inteligência artificial significa avaliar impacto, limites e riscos antes de confiar totalmente em uma ferramenta automatizada.

Essa prática ajuda a usar a tecnologia de forma consciente, especialmente quando decisões podem afetar pessoas ou informações importantes.

No cotidiano, muitas ferramentas de IA são usadas para organizar tarefas, produzir textos, analisar dados ou recomendar informações.

Essas aplicações podem ser úteis, mas ainda dependem de interpretação e supervisão humanas.

A análise ética não exige conhecimento técnico avançado. Ela consiste em observar como a tecnologia influencia decisões e quais consequências podem surgir do seu uso.

Usar inteligência artificial de forma responsável começa avaliando impacto, limites e riscos antes de aceitar automaticamente uma recomendação algorítmica.

Esse tipo de atenção se torna cada vez mais relevante à medida que ferramentas de IA passam a fazer parte de rotinas de trabalho, estudo e produção de conteúdo.

Uma forma simples de organizar essa análise é observar três perguntas básicas:

| Pergunta | O que observar |

|---|---|

| A ferramenta é confiável? | origem da tecnologia e qualidade das respostas |

| A decisão envolve impacto humano? | consequências para pessoas ou oportunidades |

| Existe supervisão humana? | possibilidade de revisar ou corrigir resultados |

Esse tipo de estrutura ajuda iniciantes a usar IA de forma mais consciente, evitando confiar automaticamente em respostas geradas por algoritmos.

Exemplo simples:

Uma ferramenta de IA pode sugerir um texto, analisar dados ou gerar recomendações de estratégia.

Antes de aplicar essas sugestões diretamente, é importante avaliar se o contexto foi compreendido corretamente e se a decisão faz sentido para a situação real.

Avaliando ferramentas de IA antes de confiar nelas

Nem toda ferramenta baseada em inteligência artificial possui o mesmo nível de confiabilidade.

Algumas são treinadas com bases de dados robustas, enquanto outras podem apresentar limitações ou erros frequentes.

Por isso, antes de confiar em uma solução automatizada, é útil observar alguns fatores básicos:

- quem desenvolveu a ferramenta

- qual é o objetivo do sistema

- se as respostas podem ser verificadas

- se existe transparência sobre como a tecnologia funciona

Ferramentas de inteligência artificial devem ser usadas como apoio à análise humana, e não como fonte automática de verdade.

Essa postura ajuda a reduzir erros causados por confiança excessiva em sistemas automatizados.

Situações em que a decisão humana deve prevalecer

Em muitos contextos, a inteligência artificial pode organizar informações ou sugerir caminhos.

No entanto, existem situações em que o julgamento humano precisa prevalecer.

Isso ocorre principalmente quando decisões envolvem:

- impacto direto em pessoas

- interpretação de contexto social

- responsabilidade legal ou institucional

Exemplo contextual:

Uma ferramenta de IA pode sugerir classificações ou priorizações com base em dados.

Ainda assim, um profissional humano precisa avaliar se essas sugestões fazem sentido no contexto real da decisão.

Quanto maior o impacto humano de uma decisão, menor deve ser a dependência exclusiva de sistemas automatizados.

Esse princípio aparece com frequência em áreas como saúde, educação, gestão de pessoas e políticas públicas.

Boas práticas para uso responsável da tecnologia

O uso responsável da inteligência artificial não depende apenas de regras formais.

Ele também envolve práticas simples que ajudam a manter controle humano sobre decisões mediadas por tecnologia.

Algumas boas práticas incluem:

- verificar informações geradas por IA antes de utilizá-las

- evitar decisões importantes baseadas apenas em recomendações algorítmicas

- considerar impacto social ou humano das decisões automatizadas

- manter supervisão humana em processos críticos

Essas atitudes ajudam a equilibrar dois elementos importantes: os benefícios da automação e a responsabilidade humana sobre decisões relevantes.

A ética no uso da inteligência artificial começa quando usuários reconhecem que algoritmos são ferramentas de apoio, não substitutos do julgamento humano.

Esse tipo de reflexão prática conecta o debate ético com o uso cotidiano da tecnologia — tema que será aprofundado nos próximos artigos deste silo.

Qual o futuro da ética em inteligência artificial?

O futuro da ética em inteligência artificial está diretamente ligado à expansão do uso de sistemas algorítmicos em diferentes áreas da sociedade.

Quanto mais a tecnologia participa de decisões humanas, maior se torna a necessidade de critérios claros de responsabilidade, transparência e supervisão.

A inteligência artificial está deixando de ser apenas uma ferramenta especializada e se tornando parte da infraestrutura digital usada em negócios, educação, serviços e produção de informação.

Essa transformação amplia o alcance da tecnologia e também a importância das discussões sobre impacto social, governança e uso responsável.

À medida que a inteligência artificial se torna parte da infraestrutura digital da sociedade, a ética passa a ser um componente essencial do seu desenvolvimento e uso.

Nos próximos anos, três movimentos devem moldar esse debate: a expansão da tecnologia, a definição de responsabilidades institucionais e o crescimento da alfabetização em IA.

A expansão da IA nos próximos anos

A inteligência artificial continua avançando rapidamente em capacidade de análise, geração de conteúdo e automação de tarefas.

Essa expansão deve ampliar o uso de sistemas de IA em áreas como:

- produtividade e organização do trabalho

- educação e aprendizagem digital

- análise de dados e tomada de decisão

- criação de conteúdo e comunicação

- serviços digitais e atendimento automatizado

Com essa presença crescente, decisões mediadas por algoritmos tendem a se tornar cada vez mais comuns.

Exemplo simples:

Ferramentas de IA já auxiliam produção de textos, análise de dados e organização de tarefas.

Nos próximos anos, esses sistemas provavelmente se integrarão ainda mais às plataformas usadas no cotidiano.

Esse cenário reforça a necessidade de compreender como a tecnologia influencia decisões e quais limites devem orientar seu uso.

Qual o papel de empresas, governos e usuários?

A discussão sobre ética em inteligência artificial não depende apenas de avanços técnicos.

Ela envolve diferentes atores responsáveis por desenvolver, regular e utilizar a tecnologia.

| Ator | Papel no uso ético da IA |

|---|---|

| Empresas | desenvolver sistemas responsáveis e transparentes |

| Governos | criar normas e diretrizes de uso |

| Usuários | utilizar ferramentas de forma crítica e consciente |

Instituições internacionais como a UNESCO, a OECD e a União Europeia já publicaram diretrizes sobre uso responsável de inteligência artificial, indicando que a governança da tecnologia será um tema cada vez mais relevante.

Essas iniciativas mostram que o debate sobre ética em IA envolve coordenação entre inovação tecnológica e responsabilidade institucional.

Por que alfabetização em IA será cada vez mais necessária?

À medida que ferramentas de inteligência artificial se tornam comuns, cresce também a necessidade de alfabetização em IA — a capacidade de compreender como esses sistemas funcionam e quais são seus limites.

Essa alfabetização não significa aprender programação ou desenvolver algoritmos. Ela envolve principalmente:

- entender como sistemas de IA utilizam dados

- reconhecer limitações de respostas automatizadas

- avaliar quando confiar ou revisar recomendações algorítmicas

Alfabetização em inteligência artificial significa compreender como sistemas automatizados funcionam, quais são seus limites e como usá-los de forma responsável.

Exemplo cotidiano:

Uma pessoa que utiliza ferramentas de IA para produzir textos ou analisar informações precisa saber que os resultados gerados são sugestões baseadas em padrões de dados, e não necessariamente respostas definitivas.

Essa capacidade crítica tende a se tornar cada vez mais importante em ambientes profissionais, educacionais e digitais.

No conjunto, esses fatores indicam que o futuro da ética em inteligência artificial dependerá não apenas da evolução tecnológica, mas também da forma como sociedade, instituições e usuários aprendem a utilizar essa tecnologia com responsabilidade.

FAQ

O que é ética na inteligência artificial?

É o conjunto de princípios que orienta como sistemas algorítmicos devem ser desenvolvidos e usados de forma responsável. O objetivo é garantir que decisões automatizadas respeitem direitos, evitem discriminação e mantenham supervisão humana quando necessário.

Qual a diferença entre automação por IA e decisão humana?

A automação identifica padrões e gera recomendações com base em dados. A decisão humana considera contexto, valores sociais e consequências morais, algo que sistemas algorítmicos não conseguem interpretar plenamente.

Como aplicar princípios éticos ao usar inteligência artificial no dia a dia?

Use critérios simples: entender o objetivo da ferramenta, verificar limitações do sistema e manter revisão humana em decisões importantes. Avaliar impacto, riscos e transparência ajuda a reduzir erros e uso inadequado.

Qual é um erro comum ao confiar em sistemas de IA?

Um erro frequente é assumir que a tecnologia é neutra ou infalível. Modelos aprendem com dados históricos e podem reproduzir vieses existentes, especialmente em decisões que envolvem pessoas ou oportunidades.

É seguro confiar totalmente nas decisões da inteligência artificial?

Não. Sistemas automatizados podem apoiar análises, mas decisões sensíveis exigem supervisão humana. Quanto maior o impacto social de uma decisão, maior deve ser a responsabilidade humana no processo.

Checklist rápido para avaliar o uso responsável de uma ferramenta de IA

Use esta lista para analisar rapidamente qualquer ferramenta de IA antes de confiar totalmente nas respostas.

Pergunte: a IA está organizando informações, gerando conteúdo ou sugerindo decisões?

Escolha uma informação gerada pela IA e valide em uma fonte confiável.

Analise se o uso da resposta pode afetar pessoas, oportunidades ou informações importantes.

Pergunte: a ferramenta realmente entende o contexto ou apenas reconhece padrões em dados?

Considere se a resposta pode conter erro factual, viés ou interpretação incompleta.

Decida se a resposta pode ser usada diretamente ou precisa de revisão humana.

Ideia central: avaliar ética no uso da inteligência artificial começa observando impacto, limites, riscos e necessidade de supervisão humana.

Grande parte das reflexões apresentadas neste artigo parte da observação prática do uso de ferramentas de IA generativa em projetos reais de conteúdo e educação digital.

A análise considera principalmente o uso cotidiano dessas tecnologias, seus limites observáveis na prática e o impacto concreto que podem ter na tomada de decisão de usuários e organizações.

Explore os guias desta série

Se você quer aplicar inteligência artificial em decisões específicas da rotina, explore os guias práticos desta série:

- Viés Algorítmico na IA: Por Que Sistemas Inteligentes Podem Reproduzir Desigualdades?

- Privacidade na Inteligência Artificial: O Que a IA Realmente Sabe Sobre Você?

- Conteúdo Gerado por IA tem Direitos Autorais? Entenda Quem é o Dono!

- IA Vai Tirar Empregos? O Que Realmente Muda no Trabalho com a Inteligência Artificial

- Podemos Confiar na IA para Tomar Decisões Importantes?

- A Caixa-Preta da IA: Por Que Nem Sempre Sabemos Como a Inteligência Artificial Decide?

- Quem é o Responsável Quando a IA Erra? Entenda o Que Acontece

- IA na Medicina é Segura? O Que já Sabemos até Hoje

- O que são deepfakes e por que são perigosos?

- É ético usar ChatGPT na escola? Quando vira desonestidade

- Custo Energético da IA: A Inteligência Artificial Pode Estar Aquecendo o Planeta?

- Precisamos de regras internacionais de IA para decisões seguras?

Afinal, quais são os verdadeiros desafios éticos da inteligência artificial hoje?

A questão central não está apenas na tecnologia em si, mas em como humanos escolhem usar, supervisionar e interpretar as decisões produzidas por sistemas algorítmicos.

A inteligência artificial amplia a capacidade de analisar dados e automatizar tarefas, mas não substitui julgamento humano, responsabilidade ou consciência ética.

Por isso, compreender limites, riscos e impactos das decisões automatizadas tornou-se uma competência essencial para quem utiliza essas ferramentas no trabalho, nos estudos e na vida cotidiana.

Ao longo deste artigo, vimos que a reflexão ética sobre IA não é um debate distante ou apenas acadêmico.

Ela surge sempre que algoritmos influenciam escolhas, filtram informações ou orientam decisões humanas.

Síntese essencial do que vimos:

- A inteligência artificial já influencia decisões reais, mesmo quando atua apenas como sistema de recomendação.

- Algoritmos reconhecem padrões em dados, mas não compreendem contexto social, moral ou humano.

- Dados históricos podem reproduzir distorções e vieses, afetando decisões automatizadas.

- A confiança excessiva em sistemas algorítmicos pode reduzir a análise crítica humana.

- O Modelo C.L.A.R.O. ajuda a avaliar tecnologia considerando consequência, limite, autoria, risco e necessidade de observação humana.

- A alfabetização em inteligência artificial será cada vez mais necessária para usar a tecnologia com autonomia e responsabilidade.

Em outras palavras, ética em inteligência artificial não é apenas um conjunto de regras.

É uma forma de pensar criticamente sobre tecnologia antes de confiar plenamente em suas respostas.

Próximo passo natural

Se você deseja compreender com mais profundidade como analisar decisões algorítmicas e usar inteligência artificial de forma responsável no dia a dia, existe um material estruturado para ampliar essa reflexão.

O Manual Ético da Inteligência Artificial apresenta princípios práticos para avaliar ferramentas de IA, entender seus limites e aplicar pensamento crítico ao usar sistemas automatizados.

Disponível na Amazon e no catálogo Kindle Unlimited.

Tati Crizan é pesquisadora independente em Inteligência de Conteúdo e fundadora dos sites CentralOnlineOficial.com.br & TatiCrizan.com, onde desenvolve e traduz estudos sobre organização da informação e uso responsável da Inteligência Artificial.