|

👇🏻 Dê o play para ouvir o conteúdo! 🔊

Getting your Trinity Audio player ready...

|

Atualizado em 11 de fevereiro de 2026

NOTA DA AUTORA: Este artigo faz parte de um trabalho contínuo de pesquisa e educação sobre Inteligência de Conteúdo e uso responsável da Inteligência Artificial, analisando como a forma de estruturar a informação impacta a compreensão, a confiança e as decisões humanas — e como sistemas de IA interpretam e reutilizam esse conteúdo.

Já aconteceu de usar inteligência artificial e precisar refazer tudo depois?

Isso é mais comum do que parece. Muitas pessoas utilizam IA todos os dias, mas aplicam respostas prontas sem critério, contexto ou validação — o que gera retrabalho, decisões frágeis e resultados inconsistentes.

Na maioria dos casos, o problema não está na tecnologia. Está na forma como ela é acionada, interpretada e aplicada no dia a dia.

Neste artigo, você vai entender quais são os 7 erros mais comuns ao usar inteligência artificial e como evitá-los com ajustes simples que melhoram clareza, produtividade e tomada de decisão.

Resumo rápido: os 7 erros mais comuns ao usar IA

- Tratar a IA como decisão final, quando ela deve funcionar como apoio à decisão humana.

- Fazer pedidos vagos e esperar precisão, sem definir objetivo, público ou aplicação.

- Não informar contexto mínimo, o que leva a respostas genéricas e pouco úteis.

- Copiar respostas sem revisar, transformando um rascunho em decisão automática.

- Não adaptar a linguagem à própria realidade, o que compromete clareza e credibilidade.

- Ignorar limites e lacunas do modelo, assumindo que a IA valida fatos ou entende situação real.

- Desistir após a primeira tentativa, sem ajustar instruções ou testar variações.

Erros comuns ao usar inteligência artificial são falhas de expectativa, instrução, avaliação ou atribuição que ocorrem quando a IA é tratada como decisão final em vez de ferramenta de apoio à decisão.

A maioria dos erros com IA não é técnica, é de expectativa

A IA falha menos por limitação técnica e mais porque as pessoas esperam dela algo que não foi pedido — ou que não cabe à ferramenta decidir.

A maioria dos erros ao usar Inteligência Artificial nasce de expectativas erradas.

A pessoa espera entendimento humano, decisão automática ou “bom senso”, quando a IA apenas responde padrões a partir do que foi solicitado.

A partir daqui, o ponto não é como a IA funciona por dentro, mas como ela é usada na prática.

Quando a expectativa está desalinhada, até ferramentas boas parecem inúteis.

IA não “entende você”, ela responde ao que foi pedido

A IA não interpreta intenção; ela processa instruções.

A IA trabalha com linguagem e dados, não com contexto implícito. Se o pedido é vago, genérico ou incompleto, a resposta tende a ser o mesmo.

Isso explica por que muitas pessoas dizem que “a IA respondeu errado”, quando, na prática, ela respondeu exatamente ao que foi possível inferir.

A IA não erra por “não entender você”. Ela erra quando precisa adivinhar.

Exemplo prático: Você pede: “Crie um texto para Instagram.” A IA não sabe:

- para quem é o perfil,

- qual o objetivo do post,

- nem o tom esperado.

Ela entrega algo genérico. Não por limitação avançada — mas por falta de direção.

Quando a expectativa está errada, o resultado sempre decepciona

Esperar decisão, contexto humano ou validação automática da IA gera frustração.

Muita gente usa IA esperando três coisas que ela não promete:

- decidir por conta própria,

- entender a situação real sem explicação,

- assumir responsabilidade pelo resultado.

Esse descompasso cria a sensação de que “IA não funciona”, quando o problema está na expectativa inicial.

Onde a expectativa costuma falhar:

- Expectativa: “Ela vai entender o que eu quero.”

Realidade: responde apenas ao que foi explicitamente pedido. - Expectativa: “Ela decide melhor que eu.”

Realidade: gera opções e possibilidades, não decisões finais. - Expectativa: “Ela valida se está certo.”

Realidade: não verifica contexto real nem consequências práticas automaticamente.

Por que isso importa no uso cotidiano?

Pesquisas em ciência de dados mostram que a qualidade da entrada humana é determinante para a qualidade da saída da IA — não apenas o modelo usado. Em outras palavras: bons dados e boas instruções importam mais do que “qual IA escolher”.

Na prática, ajustar expectativa:

- reduz retrabalho,

- evita abandono precoce da ferramenta,

- e melhora decisões mesmo em tarefas simples.

Entender o limite da IA não diminui seu uso — torna o uso mais eficiente.

Essa base de expectativa correta é o que permite identificar, nos próximos blocos, erros de instrução, avaliação e atribuição sem confusão nem excesso de teoria.

Por que esses erros atrapalham decisões, tempo e confiança na IA?

Esses erros fazem a IA parecer ineficiente, aumentam o retrabalho e levam a decisões piores — não porque a tecnologia falha, mas porque o uso quebra a lógica do sistema.

Quando a IA é usada com expectativas erradas, pedidos confusos ou sem avaliação humana, o efeito é o oposto do esperado: mais tempo gasto, decisões frágeis e abandono precoce da ferramenta.

O erro não é perder produtividade, é parar de testar

O principal impacto desses erros é fazer a pessoa concluir cedo demais que “IA não funciona”.

Na prática, o ciclo costuma ser este:

- a pessoa testa a IA sem contexto,

- recebe uma resposta genérica,

- assume que a ferramenta é limitada,

- e abandona o uso.

Isso interrompe o aprendizado básico de uso.

Sem ajustar expectativa e instrução, não há iteração — e sem iteração, não há ganho real.

A IA melhora com ajustes humanos. Quem para no primeiro resultado nunca chega ao uso eficiente.

Exemplo prático: Uma leitora pede ideias de posts, acha “fraco” e desiste. Ao refazer o pedido explicando público e objetivo, o resultado muda.

O erro não era a IA. Era a interrupção precoce do teste.

Usar IA errado gera mais retrabalho, não menos

Quando a IA é usada sem clareza e revisão, ela não economiza tempo — ela cria etapas extras.

Isso acontece porque respostas vagas precisam ser:

- corrigidas,

- adaptadas,

- ou refeitas do zero.

Onde o tempo se perde mais:

- Erro comum: Pedido genérico.

Efeito prático: resposta ampla demais e pouco aplicável. - Erro comum: Cópia sem revisão.

Efeito prático: necessidade de ajustes posteriores ou retrabalho. - Erro comum: Falta de objetivo definido.

Efeito prático: tarefa precisa ser refeita do zero.

Esse retrabalho mina a confiança na ferramenta. A pessoa passa a ver a IA como “trabalho a mais”, quando o problema está no uso inicial.

Erros de atribuição: quando a pessoa espera que a IA decida por ela

Esse erro acontece quando a pessoa transfere para a IA uma responsabilidade que é humana: decidir, validar ou assumir consequências.

Erros de atribuição surgem quando a IA é usada como autoridade final.

Em vez de apoio à decisão, ela vira substituta do julgamento humano, o que aumenta risco, reduz senso crítico e gera decisões fora do contexto real.

Aqui não falamos de falha técnica. Falamos de papel mal definido dentro do sistema.

Erro 1: Tratar a IA como especialista final

A IA organiza informações, mas não responde como especialista responsável.

A IA pode explicar, comparar e sugerir caminhos. O que ela não faz é assumir contexto completo, riscos pessoais ou consequências reais.

Segundo relatórios do NIST (National Institute of Standards and Technology), sistemas de IA não possuem compreensão situacional nem responsabilidade decisória — motivo pelo qual decisões críticas exigem supervisão humana.

A IA pode apoiar decisões. A responsabilidade continua sendo humana.

Exemplo prático: Uma pessoa pede à IA qual plano financeiro seguir. A resposta parece lógica, mas ignora renda instável e objetivos pessoais. A falha não está na resposta — está em tratar sugestão como decisão final.

Quando usada corretamente, a IA ajuda a organizar processos e automatizar tarefas — como mostro nos 5 passos para automatizar tarefas diárias com inteligência artificial.

Erro 2: Usar respostas da IA sem validar contexto real

Copiar a resposta da IA sem checar contexto transforma sugestão genérica em erro prático.

A IA responde com base em padrões médios. Ela não conhece:

- sua rotina,

- seu público,

- nem suas restrições reais.

Sem validação humana, a resposta pode até parecer correta — mas falhar na aplicação.

Onde a validação costuma falhar:

- Ação comum: Usar resposta “pronta” sem adaptação.

Risco gerado: desalinhamento com a realidade. - Ação comum: Não ajustar linguagem.

Risco gerado: perda de clareza ou credibilidade. - Ação comum: Ignorar limites pessoais ou contexto real.

Risco gerado: decisões impraticáveis.

Se você ainda tem dúvida sobre como estruturar melhor suas solicitações, vale entender a diferença entre prompt simples ou detalhado no ChatGPT.

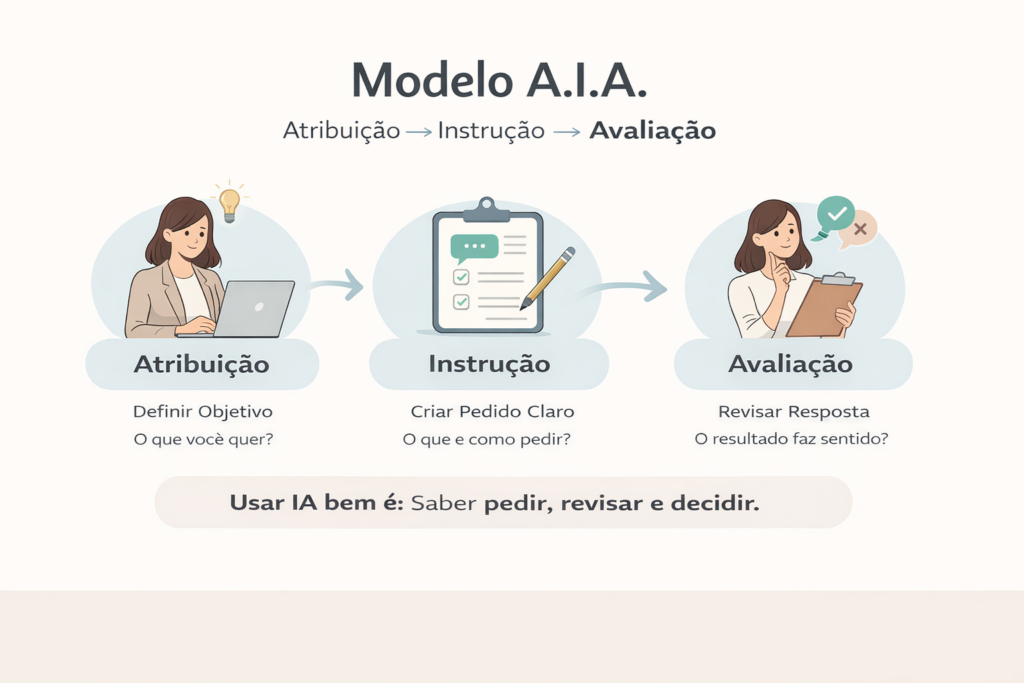

Como evitar erros de atribuição no uso cotidiano?

- Use a IA para organizar opções, não para escolher por você

- Trate a resposta como rascunho inicial, não como veredito

- Sempre pergunte: isso faz sentido no meu contexto real?

Esse cuidado simples mantém a IA no lugar certo: apoio cognitivo, não substituição do pensamento.

Erros de instrução: quando o pedido é vago e a resposta também

Quando o pedido é genérico, a IA responde de forma genérica — porque não recebeu informação suficiente para ser específica.

Erros de instrução acontecem quando a pessoa pede “algo bom” sem explicar uso, público ou objetivo.

A IA não escolhe foco sozinha; ela amplia possibilidades e entrega respostas amplas demais para aplicação prática.

Aqui, o problema não é capacidade da IA. É qualidade da entrada humana.

Erro 3: Pedir “algo bom” sem explicar o uso

A IA não sabe o que é “bom” sem contexto de aplicação.

“Bom” pode significar curto, didático, persuasivo ou técnico. Sem saber para quê o resultado será usado, a IA preenche lacunas com padrões médios.

Estudos de engenharia de prompt mostram que instruções genéricas levam a respostas vagas, enquanto instruções bem definidas e contextualizadas melhoram a relevância e precisão das respostas de IA.

A IA não falha por falta de criatividade, mas por falta de direção.

Exemplo prático: Pedido: “Crie um texto bom sobre IA.” Resultado: explicativo, neutro, longo. Ao informar uso (post de blog para iniciantes), o foco muda imediatamente.

Isso fica ainda mais evidente quando usamos IA para conteúdo e SEO, como explico em como usar inteligência artificial para criar ideias de SEO, prompts e conteúdo viral.

Erro 4: Não informar público, formato ou objetivo

Sem público e formato, a IA não consegue ajustar linguagem nem profundidade.

A IA adapta respostas quando sabe:

- quem vai ler,

- onde será usado,

- qual ação se espera do leitor.

Sem esses dados, ela entrega algo “correto”, mas desalinhado.

Informações que não podem faltar no pedido:

- Informação omitida: Público-alvo.

Efeito na resposta: linguagem genérica ou inadequada. - Informação omitida: Formato desejado.

Efeito na resposta: texto longo quando precisava ser direto. - Informação omitida: Objetivo final.

Efeito na resposta: conteúdo informativo sem direção prática.

Como melhorar instruções sem complicar?

- Diga para quem é o conteúdo

- Explique onde será usado

- Declare o que você espera que aconteça com aquele resultado

A combinação equilibrada entre análise humana e geração automática é o que garante resultado consistente — como explico em como combinar criatividade humana e IA sem perder a autenticidade.

Erros de avaliação: quando tudo é copiado e nada é pensado

Esse erro acontece quando a pessoa usa a resposta da IA sem revisar, adaptar ou refletir sobre o próprio contexto.

Erros de avaliação surgem ao tratar a saída da IA como produto final. Copiar sem pensar transfere riscos, ignora contexto e enfraquece decisões que deveriam ser humanas, mesmo quando a resposta parece correta.

Aqui, a falha não está no pedido. Está no uso da resposta.

Erro 5: Copiar e colar respostas prontas

Copiar respostas da IA sem revisão transforma um rascunho em decisão automática.

Modelos de IA geram texto provável, não verificado. Eles não confirmam fatos, não conhecem consequências locais e não avaliam impacto real.

Relatórios como o AI Index, associados ao Stanford HAI, mostram que modelos de IA ainda enfrentam limitações em tarefas que exigem entendimento contextual e sentido comum, o que reforça a necessidade de supervisão humana em decisões críticas.

A resposta da IA é ponto de partida, não ponto final.

Exemplo prático: Uma descrição de produto gerada por IA parece clara. Ao ser publicada sem revisão, usa termos que não refletem a oferta real. O problema não foi o texto — foi a ausência de avaliação.

Erro 6: Não adaptar a linguagem à própria realidade

Quando a linguagem não é ajustada, a mensagem perde clareza ou credibilidade.

A IA costuma usar um tom neutro e genérico. Sem adaptação, o conteúdo pode:

- soar distante do público,

- não refletir sua voz,

- ou criar ruído na comunicação.

Onde a adaptação costuma falhar:

- Elemento não ajustado: Tom de voz.

Impacto prático: perda de identificação do leitor. - Elemento não ajustado: Exemplos utilizados.

Impacto prático: baixa conexão com a realidade. - Elemento não ajustado: Vocabulário.

Impacto prático: dificuldade de compreensão.

Como avaliar antes de usar a resposta da IA?

- Leia a resposta como rascunho, não como versão final

- Ajuste termos, exemplos e tom ao seu contexto real

- Verifique se a informação faz sentido fora do “texto bonito”

Imagine alguém que usa IA para decidir um investimento, copia a resposta e depois percebe que ignorou sua renda instável. O problema não foi a tecnologia — foi a ausência de validação.

Esse erro fecha o ciclo do Modelo A.I.A.: mesmo com boa atribuição e boa instrução, sem avaliação humana o risco permanece.

O erro silencioso: desistir cedo demais da Inteligência Artificial

Esse erro acontece quando a pessoa conclui que “IA não funciona” após uma primeira tentativa mal ajustada.

Desistir cedo da IA é um erro comportamental, não técnico. Ele surge quando uma experiência inicial ruim é tratada como prova definitiva, interrompendo o aprendizado básico necessário para uso eficiente.

Esse erro é silencioso porque parece racional, mas bloqueia o progresso.

Erro 7: Achar que “IA não funciona” após uma tentativa ruim

Uma resposta fraca não indica falha da IA, indica ajuste incompleto do uso.

Modelos de IA respondem melhor quando há iteração mínima.

Sem ajuste de expectativa, instrução ou avaliação, o primeiro resultado tende a ser genérico — e isso é esperado.

Estudos de adoção tecnológica da OECD mostram que simples acesso ou tentativa inicial de ferramentas digitais não garante aumento de produtividade — os benefícios tendem a surgir quando há uso contínuo, capacitação e habilidades para adaptar a tecnologia às necessidades reais.

IA não é “usar uma vez e decidir”. É testar, ajustar e então avaliar.

Exemplo prático: Uma pessoa pede ideias para organizar a rotina. A resposta parece óbvia. Ela desiste. Ao refazer o pedido explicando horário, tarefas e prioridades, o resultado muda.

Para quem está começando, usar modelos prontos ajuda muito — veja esses 10 prompts básicos para ChatGPT que todo iniciante deve usar.

Por que esse erro afeta todo o sistema?

Desistir cedo interrompe:

- a construção de confiança,

- o aprendizado de como pedir melhor,

- e a percepção real de valor da IA.

No artigo Inteligência Artificial Descomplicada, explico que a IA funciona como ferramenta de apoio contínuo — não como solução instantânea. Sem esse entendimento, qualquer erro inicial pode parecer motivo para desistir.

Onde as pessoas mais se confundem ao falar de “usar IA certo”?

A confusão começa quando usar IA errado é interpretado como falha da ferramenta, e não como problema de uso, limite ou expectativa.

Grande parte da frustração com IA vem de misturar erro de uso com limitação técnica. Sem separar essas coisas, a pessoa não sabe o que ajustar, o que aprender e o que simplesmente não esperar da tecnologia.

Aqui, encerramos o recorte “erros comuns” e delimitamos o que não é tratado neste artigo.

Usar IA errado não significa que a ferramenta é ruim

Um resultado ruim não prova que a IA é fraca; indica, na maioria dos casos, uso desalinhado.

A IA responde a padrões. Quando o pedido é confuso, a avaliação é ausente ou a expectativa é irreal, o resultado reflete isso.

O 2025 AI Index Report indica que, apesar do aumento na adoção e melhorias nos benchmarks, existem desafios persistentes em confiança, segurança e avaliação responsável de IA conforme a tecnologia se insere no cotidiano real.

Resultado ruim é sinal de ajuste necessário, não de descarte imediato.

Exemplo prático: Uma pessoa pede ajuda para estudar, recebe algo genérico e conclui que “IA não ajuda”. Ao ajustar o pedido para nível iniciante e tempo disponível, o uso muda completamente.

Saber evitar erros é diferente de dominar IA

Usar IA bem no dia a dia não exige domínio técnico, exige entendimento de limites.

Evitar erros comuns significa:

- saber o papel da IA,

- saber pedir com clareza,

- e saber revisar antes de usar.

Dominar IA envolve outro nível de conhecimento — ferramentas, automação e prompts avançados — que não pertencem a este recorte.

Escopo deste artigo:

- Este artigo cobre: erros de uso cotidiano, ajuste de expectativa e leitura crítica de respostas.

- Este artigo não cobre: comparação de ferramentas, prompts avançados ou automação com agentes.

FAQ

Quais são os maiores erros ao usar inteligência artificial?

Os maiores erros envolvem expectativa equivocada, instruções vagas e ausência de revisão humana. Eles surgem quando a ferramenta é tratada como decisão final, e não como apoio à análise e organização de informações.

Qual a diferença entre erro humano e limitação da IA?

Erro humano ocorre no uso inadequado; limitação da IA é uma restrição técnica real do modelo. Confundir os dois impede ajustes simples de instrução e leva à conclusão equivocada de que a tecnologia “não funciona”.

Como usar IA no dia a dia sem comprometer decisões?

Use IA para gerar opções, estruturar ideias e comparar cenários. A decisão final deve considerar contexto real, prioridades pessoais e validação externa quando necessário.

Quais são os principais riscos de usar IA sem critério?

O principal risco é aplicar respostas genéricas em situações específicas sem validação. Isso pode gerar retrabalho, desalinhamento estratégico e decisões pouco sustentáveis no contexto real.

É perigoso conversar com IA?

Conversar com IA não é perigoso por si só. O cuidado necessário está em não compartilhar dados sensíveis e não delegar decisões críticas sem supervisão humana.

Checklist rápido para evitar erros comuns ao usar IA

- Defina em uma frase o objetivo da resposta antes de abrir a ferramenta

- Inclua contexto mínimo (público, formato, uso final) no primeiro pedido

- Peça uma segunda versão com outro enfoque para comparar qualidade

- Verifique dados, datas ou afirmações factuais em pelo menos uma fonte externa

- Ajuste o tom explicitamente (neutro, técnico, didático) antes de usar o resultado

- Reescreva manualmente o trecho final que será publicado ou decidido

- Registre o que funcionou e o que falhou no prompt para reutilização futura

Esta análise se baseia na observação prática do uso cotidiano de ferramentas de IA generativa, na revisão de materiais públicos de empresas que desenvolvem esses sistemas e na aplicação direta em projetos de conteúdo, educação digital e tomada de decisão. O foco não é teoria abstrata, mas comportamento real, limites observáveis e impacto prático.

Afinal, usar inteligência artificial no dia a dia resolve problemas ou cria novos?

Resolve quando é usada como ferramenta de apoio cognitivo; cria problemas quando substitui critério, contexto e validação humana.

O núcleo deste artigo é simples: a maioria dos erros não está na tecnologia, mas na forma como ela é acionada, interpretada e aplicada.

Em essência, evite estes pontos-chave:

- Tratar respostas de IA como decisão final

- Fazer pedidos vagos e esperar precisão

- Ignorar limites, vieses e lacunas do modelo

- Aplicar saídas genéricas em contextos específicos

- Confundir velocidade com qualidade

- Não revisar, adaptar ou validar resultados

- Delegar julgamento humano à automação

Se você percebeu que já cometeu alguns desses erros, isso é normal — o importante é ajustar o uso.

Quando esses erros são corrigidos, a IA deixa de ser um risco operacional e passa a funcionar como alavanca real de produtividade, clareza e tomada de decisão.

👉🏻 Se o objetivo é sair do uso reativo e avançar para aplicação consistente, os eBooks da Série de Inteligência Artificial Aplicada aprofundam exatamente esse ponto: como usar IA com critério, limites claros e impacto prático em conteúdo, trabalho e decisões do dia a dia.

Aqui, o foco não é aprender mais ferramentas — é aprender a pensar melhor com elas.